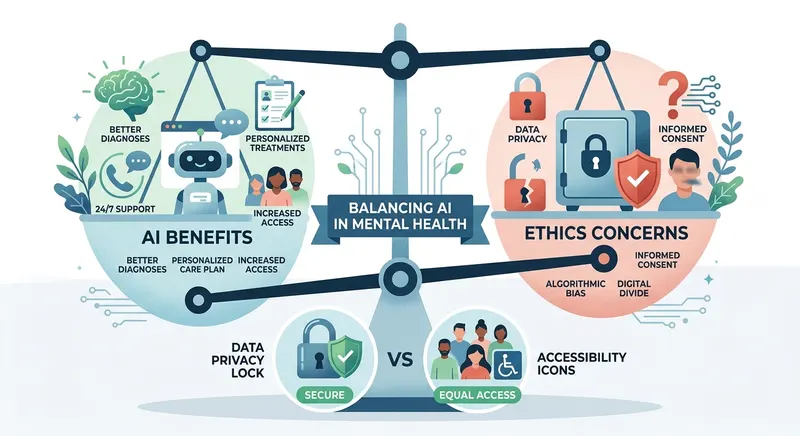

C'est un fait : l'intelligence artificielle bouleverse notre quotidien, et maintenant elle s'attaque à nos esprits — dans le bon sens du terme ! En cette année 2026, les thérapies digitales dopées à l'IA redéfinissent complètement notre approche de la dépression, du stress et des troubles mentaux en général. Mais attention, cette mutation technologique ne se fait pas sans poser quelques questions épineuses sur le plan éthique.

🚀 L'IA en santé mentale : un potentiel qui fait rêver

Franchement, quand on regarde les applications d'intelligence artificielle qui émergent dans le secteur psy, il y a de quoi être optimiste ! Ces nouveaux outils transforment littéralement notre façon d'appréhender les soins psychologiques — et les résultats parlent d'eux-mêmes.

Un soutien disponible jour et nuit

Imaginez : vous faites une crise d'angoisse à 3h du matin... Avec les thérapies traditionnelles, impossible de joindre votre psy. Mais avec ces assistants thérapeutiques intelligents ? Ils sont là, prêts à vous épauler 24 heures sur 24, 7 jours sur 7.

- Fini les interminables listes d'attente chez le psychiatre

- Une aide immédiate quand l'anxiété frappe fort

- Un premier accompagnement avant de voir un spécialiste

- Plus de problème d'éloignement géographique — parfait pour nos campagnes délaissées

Des thérapies sur-mesure, comme un costume

Là où l'IA excelle vraiment, c'est dans sa capacité à décortiquer nos données personnelles pour créer des parcours de soins ultra-personnalisés. Elle analyse nos habitudes, nos réactions émotionnelles, notre historique médical — bref, elle nous connaît mieux que nous-mêmes parfois !

Concrètement, ça donne quoi ?

- Un rythme de thérapie qui s'ajuste selon vos progrès réels

- Des alertes précoces quand ça commence à aller mal

- Des exercices personnalisés qui collent à votre personnalité

- Un monitoring permanent de votre état mental (sans être intrusif, promis !)

Démocratiser l'accès aux soins psy

Soyons honnêtes : consulter un psychologue, ça coûte cher. Les solutions numériques changent la donne en rendant les soins accessibles au plus grand nombre. Une seule app peut accompagner des milliers de personnes simultanément — essayez de faire ça avec un thérapeute en chair et en os !

⚖️ Mais attention aux dérives éthiques

Bon, tout n'est pas rose dans ce monde merveilleux de l'IA thérapeutique. Ces avancées technologiques soulèvent des questions légitimes qui méritent qu'on s'y attarde sérieusement.

Vos données intimes dans la nature ?

Parlons cash : vos pensées les plus secrètes, vos peurs profondes, vos traumatismes... tout ça finit dans des serveurs quelque part. Et ces informations ultra-sensibles font saliver bien des entreprises peu scrupuleuses.

- Risque de piratage — imaginez vos secrets sur le dark web

- Exploitation commerciale de vos faiblesses psychologiques

- Impossible d'effacer complètement vos traces numériques

- Opacité totale sur ce que font vraiment les algorithmes de vos données

Quand l'IA reproduit nos préjugés

Voici le hic : les algorithmes ne sont que le reflet de ceux qui les programment. Résultat ? Ils peuvent reproduire — voire amplifier — tous nos biais sociaux les plus moches. En santé mentale, c'est particulièrement problématique.

Les dégâts collatéraux peuvent être énormes :

- Diagnostics faussés selon votre origine ou votre sexe

- Thérapies inadaptées aux spécificités culturelles

- Oubli des minorités dans la conception des outils

- Perpétuation des clichés sur les troubles mentaux

Et si l'IA se trompe... qui paie les pots cassés ?

Voilà bien le nœud du problème : quand un algorithme fait une bourde diagnostique ou recommande un traitement foireux, qui assume la responsabilité ? Le programmeur ? L'hôpital ? L'IA elle-même (bon courage pour l'assigner en justice) ?

🛡️ Construire un cadre éthique solide

Heureusement, chercheurs et législateurs ne restent pas les bras croisés. Ils bossent d'arrache-pied pour encadrer ces technologies avant qu'elles ne dérapent complètement.

Place à la transparence !

Premier impératif : rendre ces algorithmes compréhensibles par le commun des mortels. Patients et thérapeutes doivent pouvoir saisir la logique derrière chaque recommandation — exit les boîtes noires incompréhensibles.

L'humain reste aux commandes

Rassurez-vous : l'IA n'est qu'un copilote sophistiqué, pas le pilote principal. L'œil humain garde son rôle central pour valider les diagnostics et ajuster les traitements selon le ressenti réel du patient.

Un consentement vraiment éclairé

Les utilisateurs méritent de savoir précisément dans quoi ils s'embarquent : usage de l'IA, risques potentiels, droits sur leurs données... Bref, une information claire et complète avant de signer quoi que ce soit.

🔮 Cap sur l'avenir

L'horizon des thérapies numériques assistées par l'IA s'annonce radieux — à condition qu'on gère intelligemment les écueils éthiques actuels. Les années à venir seront décisives pour poser les bonnes fondations.

Priorités absolues pour la suite :

- Blindage sécuritaire des données via des cryptages de pointe

- Conception d'algorithmes plus équitables et représentatifs

- Formation massive des soignants à ces nouveaux outils

- Harmonisation internationale des normes thérapeutiques numériques

🎯 Le mot de la fin : trouver la juste mesure

Indéniablement, l'intelligence artificielle ouvre des horizons fantastiques pour rendre les soins psy plus accessibles et sur-mesure. Mais — et c'est un gros mais — son déploiement doit impérativement respecter notre vie privée et préserver cette touche humaine si précieuse en thérapie.

Cette révolution numérique réussira uniquement si on arrive à concilier innovation technologique et valeurs humanistes fondamentales de la médecine. Envie d'approfondir ces enjeux du numérique en santé ? Échangez avec nos spécialistes CyberClinique pour un accompagnement sur-mesure dans cette mutation digitale.